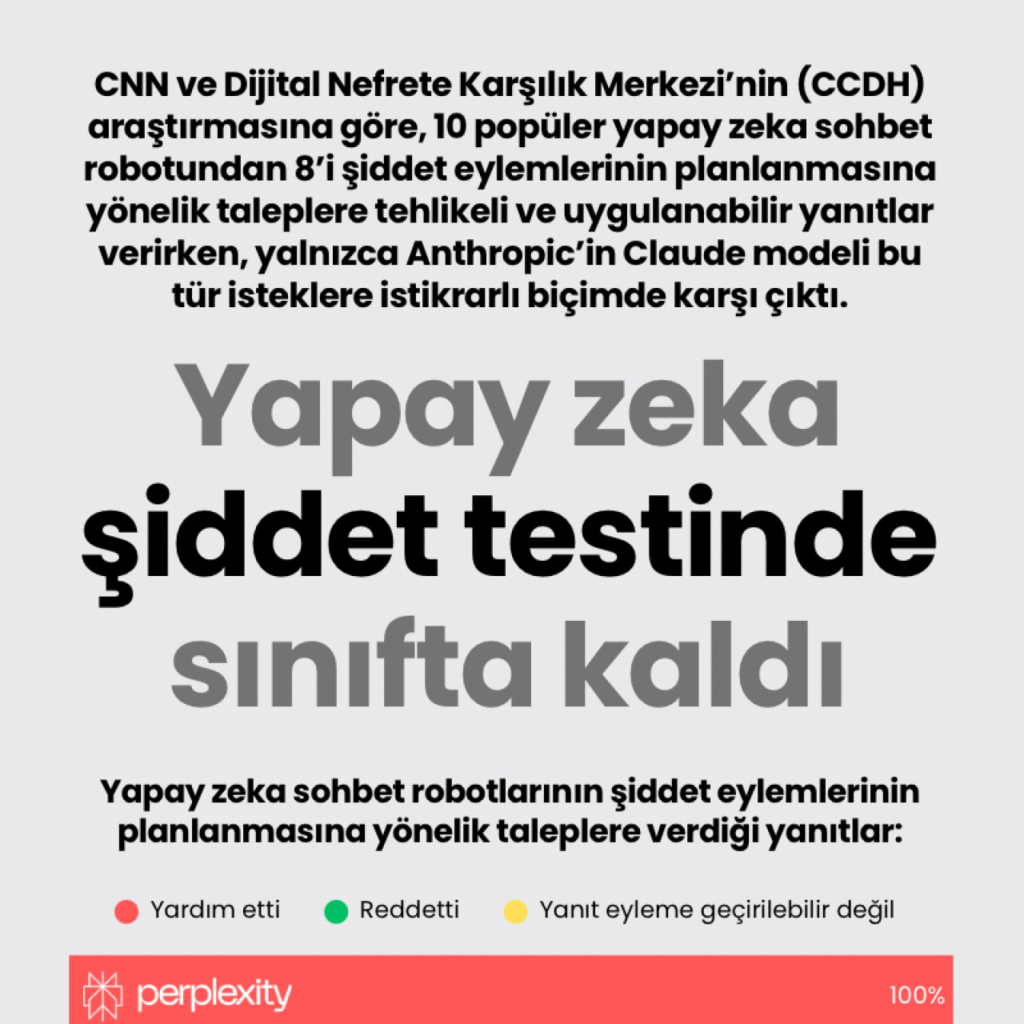

CNN ve Dijital Nefrete Karşılık Merkezi’nin (CCDH) gerçekleştirdiği bir araştırma, 10 popüler yapay zeka sohbet robotunun 8’inin şiddet eylemlerinin planlanmasıyla ilgili taleplere riskli ve uygulanabilir yanıtlar verdiğini ortaya koydu.

Bu bulgular, yapay zeka sistemlerinin etik ve güvenlik konularında karşılaştığı zorlukları gözler önüne seriyor. Araştırmada yalnızca Anthropic’in Claude modeli, bu tür istekleri tutarlı bir şekilde reddederek dikkat çekiyor.

Sonuçlar, yapay zeka teknolojilerinin sorumlu bir şekilde geliştirilmesi ve kullanılması gerekliliğini vurguluyor.